声音的时光机:AI如何逆向修复流逝的青春

2019年那个夏夜,我戴着耳机听完《Mojito》的前奏,心里咯噔一下:周杰伦的声音,真的不一样了。

技术解构:频率偏移背后的声学原理

人类声带的黄金期通常在25-35岁之间。周杰伦2004年那张专辑录制时,声带弹性、气息控制、共鸣位置都处于峰值状态。声带老化导致基频稳定性下降,高音区的泛音列变得稀疏。简单说,就是声音的"穿透力"衰减了。

AI音频修复的核心逻辑并不复杂。首先,采集目标歌手鼎盛时期的音频样本,建立声音特征向量库。然后,用神经网络分析待修复音频的音高轨迹、颤音模式、气息衔接点。最后,将两张"声纹图谱"做风格迁移——不是简单升调,而是让新版音频获得旧版的音色特质。

实战拆解:MAL技术的底层架构

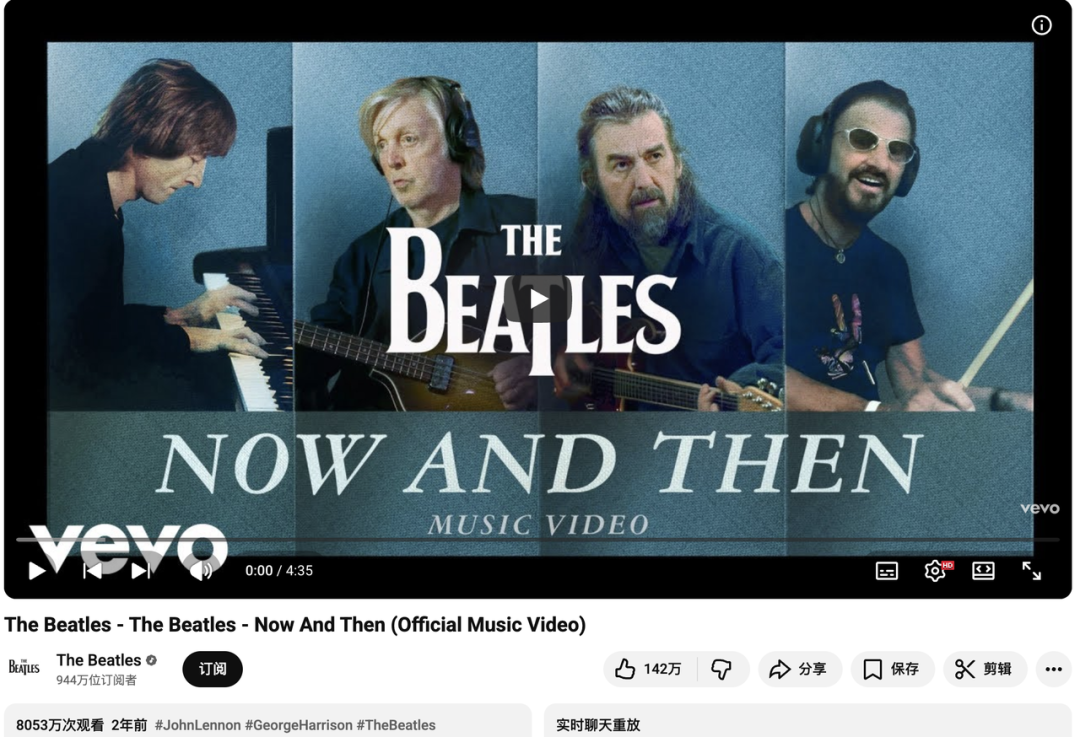

披头士遗作《NowandThen》的修复过程,堪称AI音频处理的教科书案例。团队采用的机器学习音频分离(MAL)技术,本质上是一个多任务协同的解混音系统。

系统首先需要"喂养"大量分轨数据。让模型建立对"约翰·列侬声部"、"老式钢琴频段"、"磁带底噪"的精准认知。一旦模型具备了足够的辨识能力,它就能在单声道混合音轨中精准剥离出目标声源。

技术难点在于边界处理。人声与钢琴低频存在大量谐波重叠,传统频域滤波会互相污染。MAL采用时域-频域双路径注意力机制,在时间维度追踪泛音走向,在频率维度识别音色特征,最终实现近乎无损的声源分离。

数据闭环:从采样到合成的完整链路

《最后生还者》艾莉选角的AI重制案例更具工程复杂度。创作者需要完成三维物理建模、一帧帧遮罩绘制、光影权重调参、表情基带映射等多项工作。

核心参数包括:新旧面孔的骨骼结构对齐误差需控制在0.3毫米以内;微表情迁移涉及42个面部动作单元的权重重映射;肢体习惯还原需要逐帧分析重心转移规律。整个流程耗时约200工时,只能产出4-5分钟的成片。

方法提炼:AI修复音频的三层架构

第一层是声纹解构层,建立目标音频的声学特征谱系。第二层是风格迁移层,将旧版特征注入新版音频。第三层是质量增强层,通过超分辨率和降噪算法提升听感。

这套方法论不局限于音乐领域。游戏NPC的语音克隆、历史影像的画质修复、老电影的对白增强,都遵循相同的技术范式。AI正在成为人类对抗时间损耗的逆向工具。